研究事例紹介

文書を「各次元が独立して意味を持つベクトル」に変換しよう!

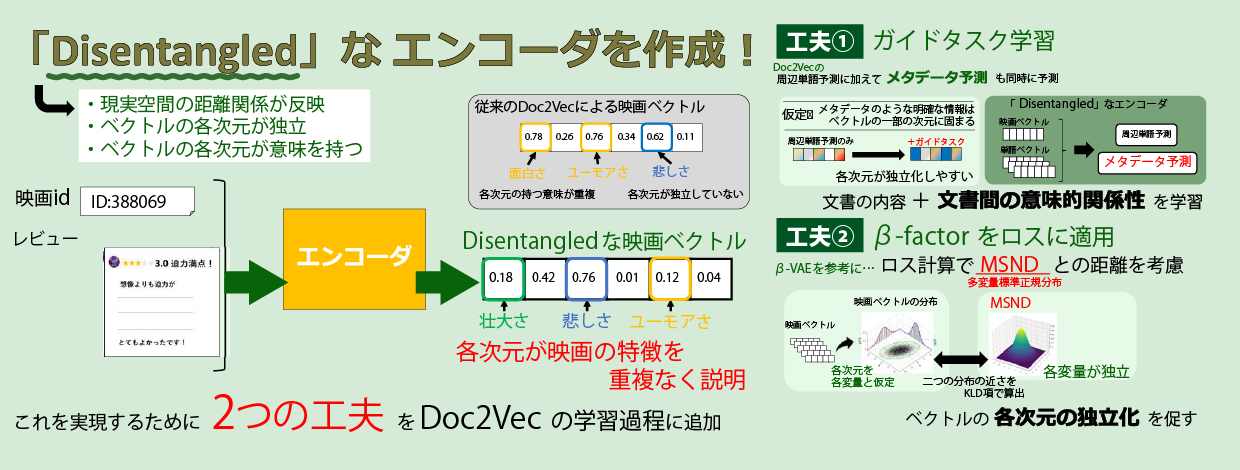

この研究では、映画レビューなどの「文書」を、各次元が独立した意味を持つ形でベクトルとして表現する方法について提案しています。 現代ではすべてのデータを数値の列(ベクトル)として扱うことは極めて一般的ですが、これまでに使われていたベクトル化手法は、ベクトルの各次元が意味を持たず、なおかつ複数の次元が連動したりしていました。 そこで、各次元が独立で、各次元がそれぞれ意味を持つように文書をベクトル化する方法を考えます。 単純で古典的な「Doc2Vec」というベクトル化手法に、各次元の独立性を担保するための正規化項を加えて、実際に各次元がばらばらで、それぞれ意味を持つ、「もつれの解けた(Disentangled)」ベクトルを得られるようにします。

近年では、どんなデータでも、とりあえず数値の列(=ベクトル)で表すようになってきています。 単語だろうが、文書だろうが、絵だろうが、楽曲だろうが、すべてベクトルとして扱うことが一般的です。 これは、類似度計算や、機械学習やAIの入力として、数値の列の形式が適しているからです。 こうした処理は「Embedding(埋め込み)」と呼ばれ、埋め込みを行うための機能は「エンコーダ」と呼ばれます。

従来のベクトル化は、そのベクトルが類似度比較や機械学習の入力に使えればいいだけだったので、各次元が独立であるかとか、各次元がそれぞれ意味を持つかなどは重要ではありませんでした。 一方で、実用上で考えると、各次元に意味を持たせることで、例えば「今の文書とほとんど同じだけど、もう少しだけ悲しみの度合いが高い文書が欲しい」という検索や、「すべての文書を、ユーモラス度合いの高い順に並び替えたい」というランキングなど、様々な便利な活用が可能になります。 こうした、各次元が意味を持ち、独立なベクトルのことを「Disentangled(「もつれの解けた」という意味)」なベクトルと呼び、特に画像のベクトル化などで古くから使われてきていました。 一方で、それらのアルゴリズムは比較的複雑で、また、テキストには応用できませんでした。

そこで、この研究では、一般的に使われる軽量ベクトル化手法のうち最も有名な「Doc2Vec」を拡張して、これまでどおりの用途に使えるうえで、各次元がそれぞれ独立して意味を持つベクトルを生成するようにしました。 Doc2Vecは、とても単純なニューラルネットワークを使って、「この文書では、この単語の周りにこの単語が現れるか」という文脈予測を利用して、文書や単語をベクトル化します。

ここで、Doc2Vecの単純なベクトル化手法をそのままに、各次元を独立化させることを考えます。 そのために、Doc2Vecのニューラルネットワークを学習する際に、

-

ガイドタスクとして、ベクトルの次元ごとに分かれそうなタスクを同時に解かせる、

-

複数の次元が連動して上がらないよう、いちいち多変量正規分布との差を確認しながら学習を進める

という工夫を加えました。 こうすることで、単純に文書と周辺単語だけを考えていたDoc2Vecは、各次元が連動しないように気を使いながら文書と周辺単語を考えるようになりました。 このように作られたエンコーダを使うと、Doc2Vecで作られたベクトルと同じように使え、なおかつ各次元が意味を持つベクトル化を行うことができると考えられます。

人間がベクトル化された文書を見ても、ただの数値の列なので意味が分からず、手法の妥当性の評価ができません。 そこで、この研究では、映画のレビューをもとに映画をベクトル表現して、映画の類似度比較を行うというタスクに落とし込んでベクトルの質を評価しました。 ベクトル同士が似た映画が、映画の内容も似通っているか、被験者に調べながら答えてもらう実験を行いました。 結果から、提案手法は確かに正しく類似度を測れるようなベクトル化が行えていることがわかりました。

また、ベクトルの各次元の独立度を測る尺度を使って、ベクトルの各次元が違う意味を持つかを評価しました。 「ベクトルの次元の直行度合い」を使った評価実験で、確かにベクトルの各次元の独立度合いが、普通のDoc2Vecよりも高まっていることがわかりました。 一方で、各次元の意味解釈については、多くの次元では「何らかの傾向を持ってその次元に割り当たっているのだと思うが、それが何なのかわからない」というような、人間の直観では次元の意味を測りきれないことが示されました。 各次元が意味を持ち、独立するようにはできましたが、次元の持つ意味が人間の直観と合うようにするには、さらなる手法改善が必要そうだということがわかりました。

文献情報

- タイトル:

- Learning Disentangled Document Representations Based on a Classical Shallow Neural Encoder

- 著者:

- Yuro Kanada, Sumio Fujita, Yoshiyuki Shoji

- 書誌情報:

- Proc. of The 27th International Conference on Information Integration and Web Intelligence (iiWAS2025), pp. 63 - 78, 2025

- 掲載サイト